Mit dem EU AI Act rücken Künstliche Intelligenz und AI Governance stärker denn je in den Fokus politischer und wirtschaftlicher Entscheidungsträger in Europa. Im April 2021 legte die EU-Kommission, im Rahmen der EU KI Strategie, einen Entwurf zum Artificial Intelligence Act (EU AI Act) vor und setzte damit einen ersten gesetzlichen Rahmenvorschlag für den ethischen Umgang mit KI-Systemen. Für Anwender birgt der kontrovers diskutierte Verordnungsentwurf Chancen und Risiken zugleich. Mit diesem Beitrag möchten wir einen kompakten Überblick über die thematischen Schwerpunkte und Herausforderungen des EU AI Act geben.

EU AI Act

Künstliche Intelligenz (KI) gehört zu den maßgebenden Technologien der Gegenwart – und der Zukunft. Schon heute spielen Prozesse algorithmischer Entscheidungsfindung eine bedeutende Rolle im alltäglichen Leben europäischer Bürger: Beim Googlen, bei der Steuerung des Pendelverkehrs, im Instagram-Feed, oder um per Mausklick herausfinden, wie es um die Kreditwürdigkeit potenzieller Kunden bestellt ist. Auch öffentliche Einrichtungen machen sich KI-Systeme zunutze. Unlängst sorgte etwa der Einsatz sogenannter Jobcenter-Algorithmen, oder ein System zur Vorhersage von Sozialleistungsmissbrauch für große Empörung und der Forderung nach gesetzlichen Grundlagen.

Klar ist: bei der Anwendung von KI-Systemen ist häufig die Grenze zwischen (ethisch) richtig und falsch nicht trennscharf – entscheidend ist der spezifische Use Case. Damit einher geht das wachsende Bedürfnis vieler Interessensgruppen aus Wirtschaft und den Wissenschaften nach einem normativen Rahmen und Rechtssicherheit. Denn klar ist auch: die enormen Potenziale von KI-System möchten genutzt werden.

Mit der EU KI-Strategy inkl. des AI Act, reagiert die EU auf die technische Errungenschaft komplexer Daten-Modelle und KI sowie den damit aufkommenden sozioökonomischen Herausforderungen. Zugleich soll die KI-Verordnung die Weichen für die Zukunft der Digitalisierung in Europa stellen und ein Innovationsmotor für eine global agierende „KI made in Europe“ werden.

Inhaltsverzeichnis

EU AI Act: Die Schwerpunkte des Regulierungsvorschlags

Was ist die Zielsetzung des AIA?

Die vorgeschlagene KI-Verordnung soll sicherstellen, dass die Europäer dem vertrauen können, was eine KI hervorbringt und garantieren, dass KI-Systeme uns Menschen nicht schaden. Die bestehenden Grundrechte und die Werte der Union sollen gewahrt und eine wirksame Durchsetzung des geltenden Rechts soll gestärkt werden. Der Mensch und die Rechtssicherheit stehen folglich im Fokus des Regulierungsvorschlags. Diese rechtskonformen und ethischen Ansprüche sollen insbesondere positive Auswirkung auf die Investitionsförderungen in KI und die Entwicklung des EU-Binnenmarktes haben.

Was steckt dahinter?

Die Leitlinien für Vertrauenswürdige KI sind das Herzstück des vorgeschlagenen EU-KI-Gesetzes und wurden von einer bestellten AI Expertengruppe (HLEG) erarbeitet. Der Rahmen stützt sich auf die Grundprinzipien der Rechtmäßigkeit, der ethischer Standards sowie Robusten KI-Systemen. Um Recht und Ethik miteinander zu verknüpfen, wurden die ethischen Grundsätze der Leitlinien von den Grundrechten abgeleitet und in sieben Schlüsselanforderungen konkretisiert, die Entwickler:innen und Anwender:innen von KI-Systemen erfüllen sollten.

- Menschliches Handeln und Aufsicht

- Vielfalt, Nicht-Diskriminierung und Fairness

- Rechenschaftspflicht

- Transparenz

- Datenschutz und Data Governance

- Ökologisches und gesellschaftliches Wohlergehen

- Technische Robustheit und Sicherheit

Diese Anforderungen sollen bestenfalls bereits in der Entwurfsphase von KI-Systemen durch spezifische Fragen berücksichtigt und operationalisiert werden.

Wie wird KI definiert?

Die Frage, was sich hinter KI verbirgt, ist gewiss nicht neu und bei weitem nicht allgemeingültig geklärt. Jedoch erfährt dieser Diskurs rund um den AI Act eine neue Brisanz. Insbesondere die unzureichende Definitionsschärfe von KI-Systemen war ein zentraler Kritikpunkt aus Wirtschaft und Wissenschaft. Denn so ließ sich der Begriff Künstliche Intelligenz im Gesetzesvorschlag von 2021 auf nahezu alle Formen von Software beziehen.

Mit dem neuen Kompromissvorschlag der tschechischen EU Ratspräsidentschaft versucht man die Unterscheidung zwischen klassischen Softwaresystemen hinreichender zu klären. Der aktuelle Vorschlag sieht vor, dass Systeme, die mit Hilfe von Ansätzen des Maschinellen Lernens (ML) sowie logik- und wissensbasierten Ansätzen entwickelt wurden, als KI-Systeme klassifiziert werden sollen.

Im Volltext lautet dies wie folgt:

‘artificial intelligence system’ (AI system) means a system that is designed to operate with elements of autonomy and that, based on machine and/or human-provided data and inputs, infers how to achieve a given set of objectives using machine learning and/or logic- and knowledge based approaches, and produces system-generated outputs such as content (generative AI systems), predictions, recommendations or decisions, influencing the environments with which the AI system interacts.

Im Vergleich zum vorherigen Vorschlag wurden statistische Ansätze, Bayessche Schätz-, Such- und Optimierungsmethoden exkludiert. Dies hätte eine sehr weitreichende Definition von KI bedeutet und wäre in der Realität kaum umzusetzen gewesen.

Was ist der aktuelle Stand des Gesetzgebungsverfahrens?

Am 11. November 2022 wurde zuletzt der finale KI-Verordnungsentwurf in seiner 5. Fassung dem EU-Parlament vorgelegt. Am 6. Dezember 2022 wird nun über das weitere Vorgehen im Rahmen der Tagung des Rates für Telekommunikation diskutiert. Dabei müssen der EU-Rat sowie das EU-Parlament eine Einigung erzielen, um den Gesetzesentwurf in Kraft treten zu lassen. Voraussichtlich werden sich diese Verhandlungen noch bis Anfang 2023 hinziehen.

Wer nichts zum laufenden Gesetzgebungsverfahren verpassen möchte kann dem Legislative Train Schedule folgen, immer mal wieder auf unserem data.blog vorbeischauen oder unseren Newsletter abonnieren. Dieses Thema wird uns sicherlich noch einige Zeit begleiten.

Wer ist betroffen?

Grundlegend gilt, sofern ein KI-System innerhalb der europäischen Union einem Menschen schaden kann, treten die Anforderungen aus dem EU AI Act in Kraft.

Konkret, sobald ein KI-System im EU Markt betrieben, vertrieben oder genutzt wird (also auch wenn der Betreiber, Anbieter oder Entwickler außerhalb der Union niedergelassen sind), greift der AI Act und die möglichen Strafen. Nach aktueller Fassung es kann bei Nichteinhaltung der Anforderungen zu Sanktionen von bis zu 30.000.000 € oder 6% des Umsatzes kommen.

Wie soll der AI Act umgesetzt werden?

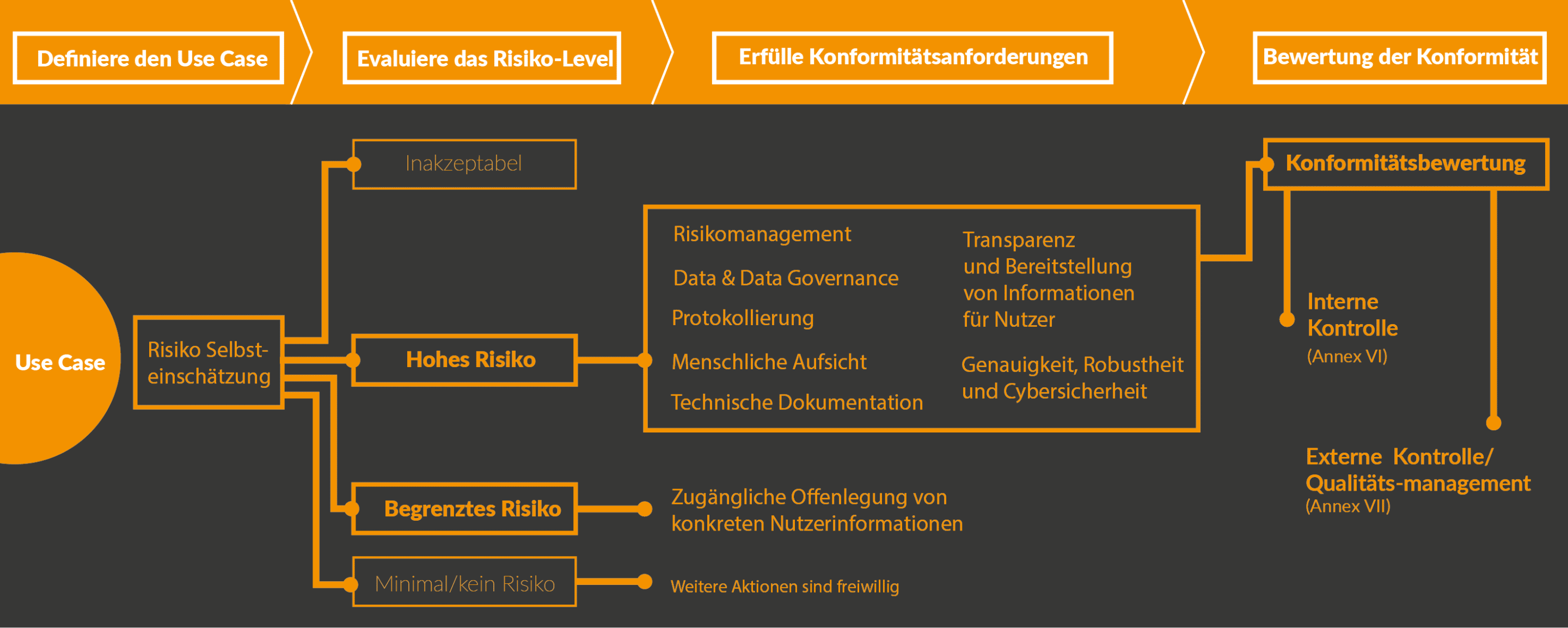

Im Entwurf der KI-Verordnung definiert der Gesetzgeber klare Anforderungen und Verpflichtungen für Entwickler, Betreiber und Nutzer von KI-Systemen. Im Kern des Ganzen steht ein Compliance-Prozess entlang des Lebenszyklus von KI-Use Cases. Dieser kann je nach den definierten Risikoklassen variieren. Risikoklassen? Genau, denn im Wesentlichen folgt der EU AI Act einem risikobasierten Ansatz. Das heißt: KI-Use Cases müssen innerhalb eines Self-Assessments bewertete werden und können dann den Risikostiften zugeordnet werden. Das Gesetz sieht hierbei eine dauerhafte Evaluierung der Anwendungsfälle nach dem aktuellen Stand der Technologie vor. Darauf aufbauend ergeben sich für die Anbieter, Betreiber und oder Nutzer des KI-System konkrete Anforderungen.

KI-Anwendungen lassen sich demnach in vier unterschiedliche Risikokategorien unterteilen:

- KI-Systeme mit inakzeptablem Risiko

- Hochrisiko-KI-Systeme

- KI-Systeme mit begrenztem Risiko

- KI-Systeme mit minimalem oder ohne Risiko

KI-Systeme mit inakzeptablem Risiko

Nach Artikel 5 des EU AI Act sollen KI-Anwendungen mit inakzeptablem Risiko verboten werden. Diese Kategorie umfasst alle Systeme, die dazu beitragen können, dass Menschen psychischen oder physischen Schaden nehmen. Dazu zählen beispielsweise Technologien, die mit manipulativen Methoden Einfluss auf das menschliche Bewusstsein nehmen. Ebenso fällt der Gebrauch von KI-Systemen durch Behörden zur Bewertung der Vertrauenswürdigkeit von Bürgern einhergehend mit einer darauf basierenden Schlechterstellung bzw. Besserstellung unter diese Risikokategorie. Der Implementierung eines Sozialkreditsystems nach chinesischem Vorbild schiebt die EU-Kommission damit den Riegel vor.

Hochrisiko-KI-Systeme

Den bedeutendsten Anwendungsbereich des EU AI Act stellen die sogenannten Hochrisiko-KI-Systeme dar. Als risikoreich werden jene KI-Systeme definiert, die in den folgenden Bereichen zum Einsatz kommen: biometrische Echtzeit-Fernidentifizierung, Sicherheitskomponenten kritischer Infrastruktur (außer im Cybersicherheitsbereich), private und öffentliche Dienstleistungen (z. B. Bonitätsprüfung von Personen), Bildungswesen, Herstellung von Sicherheitskomponenten von Produkten (z. B. in der KI-assistierten Chirurgie), Strafverfolgung und demokratische Prozesse, Asyl und Migration sowie Personalmanagement.

All diese Anwendungen können ein großes Risiko für die menschliche Gesundheit, sowie die öffentliche Sicherheit bergen. Daher beharrt die EU-Kommission hier auf strenge Governance-Auflagen. Zu den wesentlichsten Anforderungen zählen gemäß EU AI Act die Implementierung eines Risikomanagementsystems, das die Konformität von KI-Systemen kontinuierlich und iterativ evaluiert. Für Anbieter bedeutet das zunächst, dass schon vor der Markteinführung eine erste Prüfung erforderlich ist. Sobald eine neue Anwendung auf dem Markt ist, wird diese fortlaufend überwacht. Zudem wird ein Meldesystem für Vorfälle und Störungen implementiert, von dem Nutzer und Anbieter Gebrauch machen sollen.

Des Weiteren fordert der AI Act für Hoch-Risiko Systeme: Verfahren zur Data Governance, fortlaufende technische Dokumentationen, Prozessaufzeichnungen der Systemmodellierung, Transparenz und Informationspflichten für den Endnutzer, die menschliche Aufsichtsverpflichtung, sowie die Gewährleistung von Genauigkeit, Robustheit und Cybersicherheit. Sämtliche Auflagen werden in den Artikeln 8 bis 15 des KI-Gesetzesentwurfs beschrieben.

Weiterführend sieht der neue Vorschlag vor, General Purpose AI, also Modelle wie GPT-3, DALL:E & Co., die für mehrere Anwendungen verwendet werden können, als Hochrisiko-KI-Systeme angesehen werden sollen. Dies würde einen erheblichen Aufwand für die produktive Nutzung nach sich ziehen und für viele Use Cases nahezu unmöglich sein.

KI-Systeme mit begrenztem Risiko

Sämtliche KI-Systeme mit spezifischen Transparenzverpflichtungen weisen laut Artificial Intelligence Act ein begrenztes Risiko auf. Daher werden diese dem KI-Gesetzesentwurf nach kaum reguliert. Ein Beispiel hierfür wäre der Einsatz von Chatbots. Den Nutzern sollte hierbei bewusst sein, dass sie mit einer Maschine und nicht mit einem Menschen kommunizieren.

KI-Systeme mit minimalem oder ohne Risiko

Die Nutzung von Künstlicher Intelligenz mit minimalem Risiko ist ohne Einschränkungen erlaubt. Hierunter fallen beispielsweise Spamfilter oder KI-fähige Videospiele.

Kritik vonseiten des KI-Bundesverbands

Beim EU AI Act handelt es sich um den ersten Versuch einer Regulierung. Es erscheint also nicht verwunderlich, dass der Entwurf derzeit noch einige Schwachstellen aufweist. Zahlreiche Interessensgruppen machten bereits auf bestehende Mängel aufmerksam. In einer umfassenden Stellungnahme kritisierte der KI-Bundesverband beispielsweise weite Teile des KI-Verordnungsentwurfs. Generell sieht er im Artificial Intelligence Act durchaus die Chance mit “KI made in Europe” ein progressives Statement zu setzten und Europa als international konkurrenzfähigen Player in Stellung zu bringen. Dennoch würde die Erfüllung der strengen Auflagen gerade für KMU und Start-ups eine enorme Belastung darstellen. Ein derartiges Gesetzesvorhaben könnte die Entwicklung von KI in diesen Bereichen sogar behindern. Der maßgebliche Kritikpunkt des KI-Bundesverbands ist allerdings die unzureichende Definitionsschärfe. So könnte sich der Begriff Künstliche Intelligenz im Gesetzestext auf nahezu alle Formen von Software beziehen. Ebenso wurden die Beschreibungen der Risikokategorien teilweise missverständlich formuliert.

Der KI-Bundesverband schlägt überdies eine genauere Betrachtung der risikorelevanten Faktoren vor. Ganze Branchen und Bereiche unter Generalverdacht zu stellen, sei hingegen unangebracht. Um die Einhaltung der Auflagen für Hochrisiko-KI-Systeme zu erleichtern, bräuchte es bspw. spezifische Regelungen für KMU und Start-ups. Üblicherweise verfügen diese nicht über die notwendigen finanziellen Mittel, um eine lückenlose Überwachung und Dokumentation zu sicherzustellen. Zur besseren Nachvollziehbarkeit der im Artificial Intelligence Act festgeschriebenen Richtlinien wären zudem Best-Practice-Beispiele hilfreich. Tatsächlich ermöglicht der EU AI Act keinerlei Vorstellung davon, wie Unternehmer die gesetzlichen Richtlinien konkret in der Praxis umsetzen sollen.

Fazit

Die nun 5. Version des EU AI Act wird aktuell von den Abgeordneten des Parlaments überprüft und diskutiert. Am 6. Dezember soll der Rat der Europäischen Union im Rahmen der Tagung für Telekommunikation über das weitere Vorgehen entscheiden. Der risikobasierte Verordnungsentwurf setzt die notwendigen gesetzlichen Rahmenbedingungen für einen ethischen Umgang mit KI in einem digitalisierten Europa. Doch der Artificial Intelligence Act sorgt bei Unternehmern und Interessensvertretungen zurecht für Unbehagen. Das Hauptaugenmerk des Gesetzestextes liegt auf den nicht immer trennscharf definierten Hochrisiko-KI-Systemen. Diese unterliegen zahlreichen gesetzlichen Auflagen, deren Erfüllung für junge und kleinere Unternehmen eine schwierige Aufgabe darstellen dürfte. Damit würde er in jetziger Form die Innovation im Bereich KI von europäischen KMUs bremsen und größeren Unternehmen den Betrieb produktiver KI-Systeme erschweren. Daher bleibt zu hoffen, dass einzelne KI-Risikobereiche noch trennschärfer definiert werden und der Artificial Intelligence Act nicht zur Innovationsbremse im internationalen Vergleich wird.

0 Kommentare